AI 버블론: 4가지 질문

AI 버블론이 대두되면서 작년부터 급등하였던 AI 관련 기업들의 주가가 최근 크게 하락하고 있다. 투자자들은 또 다른 닷컴 버블을 우려하고 있다. 역사적으로 항상 버블이 있어 왔고 그 버블은 꺼지기 마련이었다. 하지만 아이폰과 안드로이드가 촉발시킨 모바일 혁신과 같이 버블 없이 꾸준히 발전한 예외적인 상황도 있다. 본 포스트에서는 AI 버블론과 그 반론에 대해 살펴보기로 하자.

AI 버블론

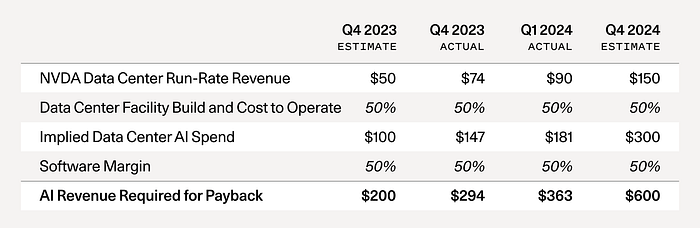

대표적인 AI 버블론 중 하나로는 세콰이어 캐피털의 데이비드 칸(David Cahn)이 2023년 9월에 제기한 “AI’s $200B Question”이 있다. 데이비드 칸이 이 글에서 제기한 논리는 다음과 같다:

- 가정 #1: GPU에 1달러를 지출할 때마다, 그 GPU를 실행하는 에너지 비용으로도 1달러가 지출된다.

- 가정 #2: GPU의 최종 사용자(예: 스타벅스, X, 테슬라, Github Copilot 또는 신규 스타트업)의 마진율은 50%이다.

이 두 가지 가정에 따르면, 매년 GPU 관련 자본 지출(CapEx)은 2,000억 달러에 이르며, 기업들은 초기 자본 투자를 상환하기 위해 최소한 2,000억 달러의 수익을 창출해야 한다는 결론에 이른다. 데이비드 칸이 제기한 논리에 따르면, GPU 관련 자본 지출(CapEx)을 다음과 같이 계산할 수 있다.

- 2023년 엔비디아의 총 매출: 500억 달러

- 총 에너지 비용: 500억 달러 (GPU를 실행하는 데 드는 에너지비용)

- 업계가 마진율 50%를 유지하기 위해 벌어야 하는 추가 수익: 1,000억 달러

이를 모두 합하면 GPU CapEx는 총 2,000억 달러에 이르게 된다.이 논리는 AI 산업의 과도한 투자와 수익 창출 간의 괴리를 강조하며, 많은 사람들이 AI 버블론의 근거로 삼고 있다.

데이비드 칸은 “AI’s $200B Question”를 제기하면서, 주요 기술 기업들이 AI에서 얻을 수 있는 수익을 매우 관대하게 가정했다. 예를 들어, MS, Google, Meta, Apple이 각각 100억 달러, Oracle, Bytedance, Alibaba, Tencent, X, Tesla가 각각 50억 달러의 수익을 얻는다고 할 때, AI 업계의 예상 총 수익은 다음과 같이 산출된다.

- MS, Google, Meta, Apple: 400억 달러

- Oracle, Bytedance, Alibaba, Tencent, X, Tesla: 300억 달러

- 기타 기업들: 50억 달러

이를 모두 합하면 총 750억 달러의 수익이 예상된다. 하지만 GPU 관련 자본 지출(CapEx)은 2,000억 달러에 달하므로, 여전히 1,250억 달러(=2,000억-750억) 이상의 자본 지출을 충당해야 하는 큰 결손이 발생한다는 점을 칸은 지적한다. 칸은 이러한 결손을 바탕으로 두 가지 중요한 질문을 던진다.

- 1. 현재의 설비 투자가 실제 최종 고객 수요와 얼마나 연결되어 있는가?

- 2. 얼마나 많은 투자가 미래의 최종 고객 수요를 예상하여 이루어지고 있는가?

더 나아가 칸은 2024년 엔비디아의 매출이 급증하면서, AI 산업에서 다루어야 할 문제의 규모가 기존의 2,000억 달러에서 6,000억 달러 규모로 확대되었다고 지적한다.(“AI’s 600B Question”) 이는 AI 관련 자본 투자가 현재의 수요를 충족시키지 못하고 있거나, 미래의 잠재적 수요를 지나치게 낙관적으로 평가하고 있다는 우려를 반영하고 있다.

또한 칸은 AI’s 600B Question에서 AGI가 당장 달성될 수 있다라는 망상에 대해서도 경계한다.

Speculative frenzies are part of technology, and so they are not something to be afraid of. Those who remain level-headed through this moment have the chance to build extremely important companies. But we need to make sure not to believe in the delusion that has now spread from Silicon Valley to the rest of the country, and indeed the world. That delusion says that we’re all going to get rich quick, because AGI is coming tomorrow, and we all need to stockpile the only valuable resource, which is GPUs. (투기 열풍은 기술의 일부이므로 두려워할 필요가 없습니다. 이 순간에도 냉정함을 유지하는 사람들은 매우 중요한 회사를 만들 수 있는 기회를 갖게 됩니다. 하지만 실리콘 밸리에서 미국 전역, 나아가 전 세계로 퍼져나간 망상을 믿지 말아야 합니다. 그 망상은 AGI가 내일 다가오기 때문에 우리 모두가 빨리 부자가 될 것이며, 우리 모두는 유일하게 가치 있는 자원인 GPU를 비축해야 한다고 말합니다.)

반론

앞에서 소개한 AI 버블론으로부터 4가지 질문을 이끌어낼 수 있다.

- Question1: AI 수요가 실제로 증가하고 있나?

- Question2: 실제로 수익을 얻고 있나?

- Question3: AI 업계가 AI에 과잉 투자하고 있지 않나?

- Question4: AGI를 근시일 내에 달성할 수 있나?

이와 같은 질문에 대해서 최근 AI 동향에 대해서 살펴보기로 하자.

Question1 : AI 수요가 실제로 증가하고 있나?

Closed foundation model의 대표주자인 OpenAI와 open-source foundation model의 대표주자인 Meta는 실제로 AI에 대한 수요가 급증하고 있음을 강조하고 있다.

OpenAI

- ChatGPT의 주간 활성 사용자: 2억명 (2023년 11월 대비 2x)

- Fortune 500 기업의 92%가 사용 중

- GPT-4o mini 출시(7월) 이후 자동화 API 사용량이 2x 증가

Meta

- 2023년 같은 시기에 비해 Llama 다운로드 수가 10x 증가 (총 350M 건 다운로드, 2024년 7월 한달간 20M 건 다운로드)

- Llama 3과 Llama3.1을 출시한 2024년 5월에서 7월까지 단 3개월 만에 주요 CSP 파트너사의 Llama 토큰 볼륨이 2x 이상 증가

- Meta AI의 주간 활성 사용자는 1억8천만명 이상(월간 활성 사용자는 4억명 이상)

Question2: 실제 수익을 얻고 있나?

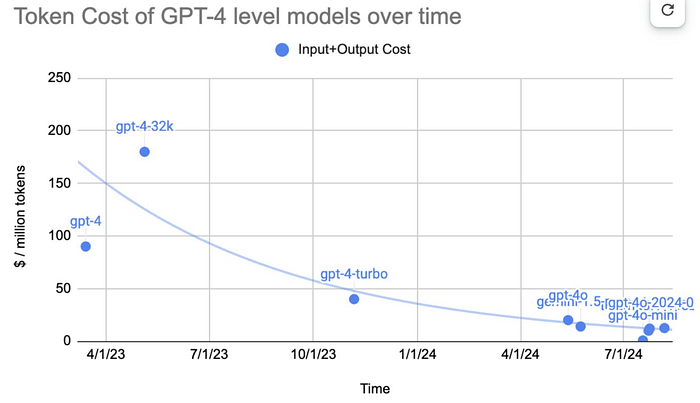

OpenAI는 자사 제품인 ChatGPT Enterprise(‘23년8월 출시), ChatGPT Team(‘24년1월 출시), ChatGPT Edu(‘24년 5월 출시) 등의 유료 사용자 수가 2024년 9월 5일 기준으로 100만 명을 돌파했다고 발표하였다. 이러한 성과는 특히 2024년 7월에 출시된 GPT-4o mini 덕분에 이루어진 것으로 평가된다. 이 모델은 토큰 가격을 대폭 낮춘 버전으로, API 사용이 크게 증가한 주요 요인으로 작용하였다. 이로써 GPT-4의 1M 토큰당 가격은 1년 2개월만에 최대 240배 저렴해졌다.

- gpt-4–32k(‘23년 5월): $180/1M token

- gpt-4o-mini(‘24년 7월): $0.75/1M token

OpenAI는 활성 사용자와 유료 사용자가 크게 증가하고 있지만 실제로 수익을 내고 있을까? OpenAI의 매출은 지난해 16억 달러였으며 올해 이미 20억 달러를 넘어섰다. 지난해보다 2배 이상인 총 34억 달러가 목표이다. 하지만 OpenAI가 수익을 얻기엔 여전히 지출이 매출을 크게 상회하고 있다. The Information의 추정치에 따르면 OpenAI가 올해 최대 85억 달러를 지출할 예정이다.

- 서버 임대 (약 40억 달러)

- 모델 학습 비용(최대 30억 달러. 서버 시간, 데이터 수집+정리, 타사 데이터 라이선싱, 에너지 비용 등)

- 인건비(15억 달러/년)

이 추정치가 맞다면 OpenAI는 올해만 약 50억 달러의 손해를 볼 것으로 전망된다. 이와 같은 상황으로 인해 OpenAI는 구독료 인상 및 새로운 자금 조달을 논의 중이다.

구독료 인상

- OpenAI o1(Strawberry): OpenAI는 2024년 9월 12일, 복잡한 문제를 해결하기 위해 개발된 새로운 추론 모델인 OpenAI o1-preview을 발표하였다. OpenAI o1-preview는 GPT-4o에 비해 입력 토큰 비용은 3배, 출력 토큰 비용은 4배 비싸다. 반면, o1-mini는 GPT-4o mini에 비해 입력 토큰 비용, 출력 토큰 비용 모두 20배 비싸다.

- GPT-5(Orion): 더 나아가 OpenAI의 임원진들은 차세대 flagship LLM인 GPT-5의 월 구독료를 최대 2천 달러로 인상하는 방안을 논의하고 있다. (현 ChatGPT plus의 구독료는 20달러/월)

신규 자금 조달

- OpenAI는 65억 달러 규모의 펀딩 및 은행으로부터 50억 달러 대출, 총 115억 달러 규모의 자금을 확보에 나선 것으로 알려졌다. 이번 펀딩에는 다수의 벤처 투자사뿐만 아니라, MS, Apple, NVIDIA 등이 포함된 것으로 알려졌다.

- 이번 자금 조달을 통해 OpenAI의 기업가치는 약 1,500억 달러에 이를 것으로 기대됩니다.

Question3: AI 업계가 AI에 과잉 투자하고 있지 않나?

2024년, Microsoft, Google, Meta는 AI 인프라에 대한 투자를 크게 확대했다. 2024년 1분기 동안 이 세 회사는 AI 관련 자본 지출에 총 320억 달러 이상을 사용했으며, 이 자본은 주로 데이터 센터의 구축 및 업그레이드, AI 모델 학습 및 배포에 필요한 GPU와 같은 하드웨어 확보에 집중되었다.

- Microsoft는 2024년 1분기에 약 140억 달러를 자본 지출에 사용했으며, 이는 전년 대비 79% 증가한 수치로 대부분이 AI 인프라 투자에 사용되었다.

- Google은 2024년 1분기에 120억 달러를 지출했으며, 이는 90% 증가한 수치로, AI 및 클라우드 인프라에 대한 투자가 주도했다.

- Meta는 2024년 동안 AI 인프라에 350억에서 400억 달러를 투자할 계획이며, 1분기에 이미 67억 달러를 사용했다.

투자자들이 가장 우려하는 점은 AI 업계가 수요에 비해 과잉 투자를 장기간 지속해야 한다는 위험이다. AI 인프라와 하드웨어에 막대한 자본이 투입되고 있지만, 실제 수익이 그에 비례하지 않을 경우 리스크가 발생할 수 있다.

이러한 우려에 대해 Big Tech 기업들은 AI관련 자본 지출에 대해 장기적인 관점에서 투자를 진행하고 있다고 설명하지만, OpenAI와 같은 신생 기업의 급부상에서도 볼 수 있듯 AI 기술 발전 속도가 매우 빨라, 경쟁에서 뒤처질 경우 기업들이 감당해야 할 패널티가 매우 크기 때문에 이를 피하고 싶은 것이 실제 기업들의 속내라는 시각도 존재한다. 다음은 과잉투자에 대한 Big Tech의 견해이다.

1.Alphabet 2024 2Q Earnings call (July 23, 2024)

(Ross Sandler. Barclays) So it looks like, from the outside at least, that the hyperscaler industry going from kind of an underbuilt situation this time last year to better meeting the demand with capacity right now to potentially being overbuilt next year if these CapEx growth rates keep up. So do you think that’s a fair characterization? And how are we thinking about the return on invested capital with this AI CapEx cycle? (따라서 적어도 겉으로 보기에는 하이퍼스케일러 업계가 작년 이맘때에는 과잉 구축된 상황에서 지금은 용량으로 수요를 더 잘 충족하고 있지만, 이러한 설비투자 증가율이 유지된다면 내년에 과잉 구축될 가능성이 있는 것처럼 보입니다. 그렇다면 이것이 공정한 특성화라고 생각하시나요? 그리고 이러한 AI 자본 투자 주기에 따른 투자 자본 수익률에 대해 어떻게 생각하시나요?)

(Sundar Pichai. 구글 CEO) : The one way I think about it is when you go through a curve like this, the risk of underinvesting is dramatically greater than the risk of overinvesting for us here. Even in scenarios where if it turns out we are overinvesting, these are infrastructure which are widely useful for us, they have long useful lives, and we can apply it across and we can work through that. (제가 생각하는 한 가지 방법은 이런 곡선을 거칠 때 과소 투자의 위험이 과잉 투자의 위험보다 훨씬 더 크다는 것입니다. 우리가 과잉 투자하는 것으로 판명되는 시나리오에서도 이러한 인프라는 우리에게 널리 유용하고 수명이 길며 전반적으로 적용할 수 있으며 이를 극복할 수 있습니다.)

2. Microsoft FY24 Fourth Quarter Earnings Conference Call (July 30, 2024)

(Amy Hood. Microsoft CFO) …

Overall, server products and cloud services revenue grew 21% and 22% in constant currency. Azure and other cloud services revenue grew 29% and 30% in constant currency, in line with expectations and consistent with Q3 when adjusting for leap year. Azure growth included 8 points from AI services where demand remained higher than our available capacity. (전체적으로 서버 제품 및 클라우드 서비스 매출은 불변 통화 기준으로 21%와 22% 성장했습니다. Azure 및 기타 클라우드 서비스 매출은 윤년을 조정한 3분기와 마찬가지로 예상에 부합하는 일정 통화 기준 29% 및 30% 성장했습니다. Azure 성장에는 가용 용량에 비해 수요가 높은 AI 서비스에서 8포인트가 포함되었습니다.)

…

In Azure, we expect Q1 revenue growth to be 28% to 29% in constant currency. Growth will continue to be driven by our consumption business, inclusive of AI, which is growing faster than total Azure. We expect the consumption trends from Q4 to continue thru the first half of the year. This includes both AI demand impacted by capacity constraints and non-AI growth trends similar to June. Growth in our per-user business will continue to moderate. And in H2, we expect Azure growth to accelerate as our capital investments create an increase in available AI capacity to serve more of the growing demand. (Azure의 1분기 매출 성장률은 불변 통화 기준으로 28%에서 29%에 달할 것으로 예상합니다. 전체 Azure보다 빠르게 성장하고 있는 AI를 포함한 소비 비즈니스가 성장을 계속 주도할 것입니다. 4분기의 소비 트렌드는 올해 상반기까지 계속될 것으로 예상합니다. 여기에는 용량 제약의 영향을 받는 AI 수요와 6월과 유사한 비AI 성장 추세가 모두 포함됩니다. 사용자당 비즈니스의 성장은 계속해서 완만해질 것입니다. 그리고 하반기에는 증가하는 수요를 더 많이 충족하기 위해 자본 투자를 통해 사용 가능한 AI 용량이 증가함에 따라 Azure의 성장이 가속화될 것으로 예상합니다.)

(Mark Zuckburg. Meta CEO) And future models will continue to grow beyond that. It’s hard to predict how this will trend multiple generations out into the future. But at this point, I’d rather risk building capacity before it is needed, rather than too late, given the long lead times for spinning up new infra projects. And as we scale these investments, we’re of course going to remain committed to operational efficiency across the company. (그리고 미래 모델은 그 이상으로 계속 성장할 것입니다. 이것이 앞으로 여러 세대에 걸쳐 어떻게 발전할지 예측하기는 어렵습니다. 하지만 현 시점에서는 새로운 인프라 프로젝트를 가동하는 데 걸리는 시간이 길다는 점을 고려할 때 너무 늦기 전에 역량을 구축하는 위험을 감수하는 편이 낫다고 생각합니다. 그리고 이러한 투자를 확대하는 과정에서 회사 전체의 운영 효율을 높이기 위한 노력도 계속할 것입니다.)

AI는 국가 경쟁력과 국가 안보에 지대한 영향을 미치므로 AI에 대한 지출을 단순히 경제 논리로 접근하는 것은 위험하다. 기업이나 국가가 AI 경쟁에서 뒤처지면 경제적, 군사적 우위를 잃고 국가 안보에 심각한 도전에 직면할 가능성이 높다. 따라서 AI 주도권 경쟁은 과거 냉전 시기 우주 경쟁과 같이 대규모 자본 지출은 피할 수 없다.

Question4: AGI를 근시일 내 달성할 수 있나?

AGI(Artificial General Intelligence)에 대한 정의는 연구자마다 다르기 때문에, AGI를 논의하기 전에 먼저 그 정의를 확립하는 것이 중요하다. OpenAI는 AGI 개발 과정을 5단계로 나누었으며, 이 분류에 따르면 OpenAI의 ChatGPT는 Level-1과 Level-2 사이 수준에 해당한다. AGI는 Level-5를 뛰어넘었을 때 달성되었다고 볼 수 있다. OpenAI의 정의에 따른 각 단계는 다음과 같다:

- Level-1 (Chatbots): 사람과 대화로 상호작용할 수 있는 AI

- Level-2 (Reasoners): 박사 수준의 인간처럼 문제를 해결할 수 있는 AI

- Level-3 (Agents): 며칠 동안 사용자 대신 독립적으로 행동할 수 있는 AI

- Level-4 (Innovators): 혁신적인 아이디어나 기술을 개발할 수 있는 AI

- Level-5 (Organizations): 사람으로 구성된 조직의 업무를 대신 수행할 수 있는 AI

OpenAI의 샘 알트만과 미라 무라티는 AGI를 10년 내 달성될 수 있을 것으로 전망하였으며 지난 3월, 엔비디아 젠슨 황은 AGI를 특정 테스트를 통과할 수 있는 능력으로 정의한다면 5년 이내에 도달할 수 있을 것이라고 전망하였다.

그러나 AGI 달성에 대한 회의적인 견해도 존재합니다. 현재의 대규모 언어 모델(LLM)은 기본적으로 확률적 앵무새에 가까워, 모델 구조의 한계로 인해 AGI에 도달하지 못할 것이라는 의견이 있다. 또한, 현재 LLM 성능 개선 방식은 scaling law에 의존하는 한계 때문에, 전력 제약, 칩 제조 능력, 데이터 부족, 대기 시간 벽과 같은 현실적 문제에 직면할 것이라는 비판도 있습니다.

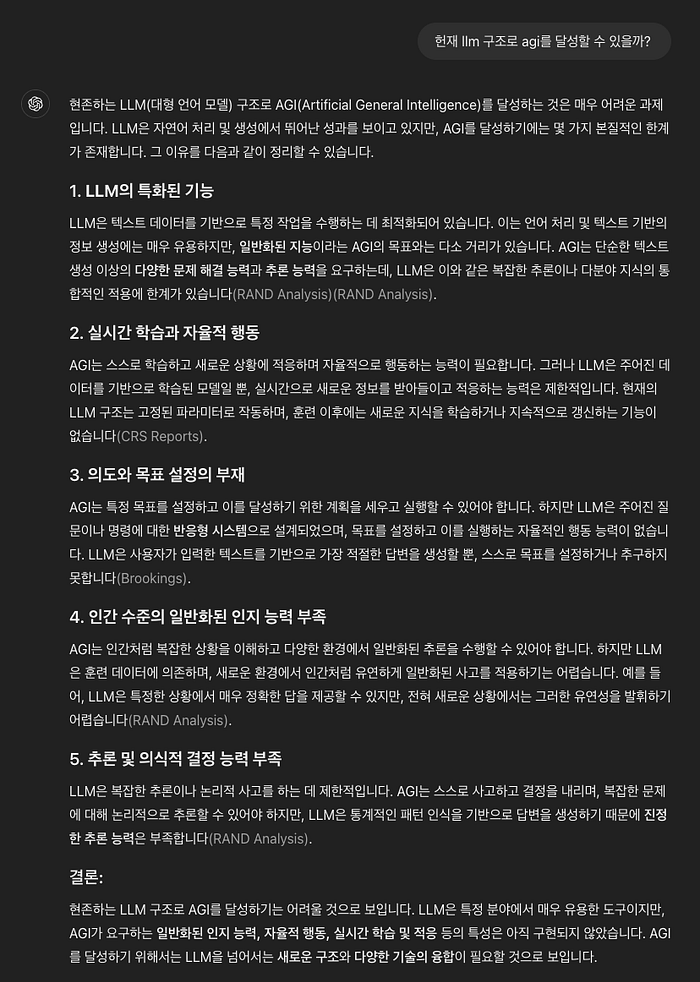

다음은 ChatGPT에 현재 LLM 구조로 AGI를 달성할 수 있을지, LLM으로 AGI를 달성하기 위해 필요한 기술이 무엇인지 질문한 결과이다.

위의 ChatGPT의 자기 고백(?)과 같이 현재 LLM 구조로 AGI를 달성하는 것은 큰 한계가 있을 것으로 전망된다. 하지만 반드시 최고의 기술이 성공하는 것이 아니 듯, 필자는 LLM 개발으로 촉발된 AGI을 향한 목표는 여러가지 방법을 통해 가능할 것으로 기대한다.

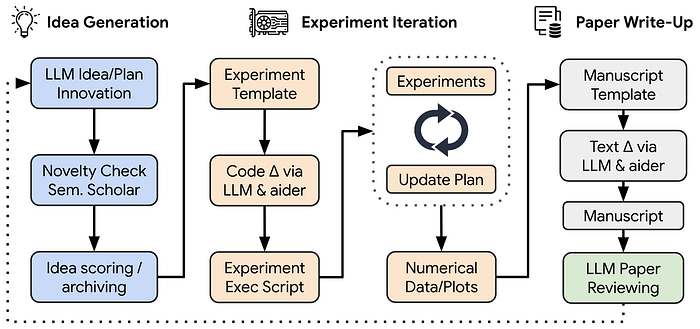

그 예로 일본의 스타트업인 sakana.ai가 발표한 “The AI scientist”와 같은 방법이다. “The AI Scientist”는 세 단계로 구성된 프로젝트(아이디어 생성-실험 반복-논문 작성)로 과학적 발견을 완전히 자동화하는 것을 목표로 한다. 만일 이와 같은 방법론이 정착될 수 있다면 AI로 새로운 AI를 개발할 수 있다.

이와 같은 방법론은 전 OpenAI 연구자였던 Leopold Aschenbrenner가 II. From AGI to Superintelligence: the Intelligence Explosion에서 주장한 것과 같이 AGI를 이용하여 초지능으로 갈 수 있다라는 방법론과 일맥상통하다.

또한 OpenAI의 수석과학자였던 일리야 슈츠케버는 OpenAI를 퇴사한 후 SSI(Safe SuperIntelligence)를 설립하였다. 그는 현재 AI 발전을 견인했던 기존 scaling law와 다른 개념으로 초인공지능을 개발하겠다라는 포부를 밝혔다. 기존 scaling law은 너무 많은 자원을 요구하기 때문에 AGI로 가기 위해선 반드시 넘어야 하는 산과 같기 때문이다.

향후 전망

미래를 전망하기 위해선 과거를 알아야 한다. 지금의 AI 버블은 과거 닷컴 버블을 연상하게 한다. 1990년대 말과 2000년대 초, 인터넷의 힘을 통해 산업을 혁신하겠다고 약속한 ‘닷컴’에 대한 투자 열풍이 불었던 시기였다. 웹과 인터넷의 잠재력에 이끌린 투자자들이 실질적인 수익이나 검증된 사업 모델이 없음에도 불구하고 벤처기업들에 돈을 쏟아부으면서 주가가 치솟았다. 하지만 이와 같은 주가 급등은 지속 불가능하였으며 거품이 터졌을 때 닷컴 기업들의 가치는 폭락했다.

현재 AI 버블은 다음과 닷컴 버블과 유사점과 차이점 있다.

유사점

- 높은 기대감: AI와 닷컴 버블 모두, 당시의 신기술이 세상을 극적으로 바꿀 것이라는 기대감이 컸다.

- 막대한 투자: 두 경우 모두 투자자들이 입증된 수익성보다는 해당 기술의 잠재력에 근거해 막대한 투자를 감행했다.

- 기업의 평가 가치(Valuation) 급등: AI 관련 기업들의 평가가치와 주가는 최근 몇 년간 급격히 상승했으며, 닷컴 버블 때도 기술 기업들의 기업가치가 비슷하게 급등하였다.

차이점

- 기술적 성숙도: AI는 10년 이상 꾸준한 발전을 거쳐왔고, 다양한 실용적인 응용 분야에서 성공을 입증하였다. 반면, 닷컴 버블 당시의 인터넷 기반 기술은 상대적으로 미성숙하고 개념 이상의 기술을 갖추지 못하였다.

- 시장 이해도: AI 기술에 대한 이해도는 닷컴 버블 당시의 인터넷 기술에 비해 훨씬 높다. 투자자와 기업 모두 AI의 기술적 가능성과 한계에 대해 더 잘 이해하고 있다.

- 사업 모델 평가: 닷컴 버블의 실패를 통해 투자자와 기업은 사업 모델의 현실성을 보다 신중하게 평가한다.

필자는 ChatGPT 사용 전과 후의 생산성 증가를 직접 경험한 만큼, AI의 여러 한계를 인식하면서도 단기적 비관론과 장기적 낙관론의 입장에서 AI 산업의 성장을 기대하고 있다. (이는 필자가 AI와 관련된 산업에 종사하고 있기 때문이기도 하다.)

현재 생성형 AI 기술은 극초기 단계에 있으며, AI에 대한 맹목적인 믿음이나 만능주의에서 벗어나 현실적인 기술의 한계를 고민해야 할 시기라고 생각한다. 지금 중요한 것은 “AI가 무엇을 할 수 있는지”에 대한 구체적인 이해와 활용 방안이다. AI 버블이 진정으로 도래하는 순간은, “AI가 모든 것을 해결해줄 것”이라는 분위기가 지배적이 될 때일 것이다.

레퍼런스

[1] Building A Generative AI Platoform

[4] OpenAI says ChatGPT usage has doubled since last year

[5] With 10x growth since 2023, Llama is the leading engine of AI innovation

[6] OpenAI hits more than 1 million paid business users

[7] Cost of 1M tokens has dropped from $180 to $0.75 in ~18 months (240X cheaper!)

[8] OpenAI may reportedly lose $5B this year alone on massive ChatGPT costs

[9] [기술 거물들이 OpenAI에 올인] OpenAI에 대한 관심이 뜨겁다. Nvidia, Apple, Microsoft가 모두 이 스타트업의 최신 펀딩 라운드에 기여하는 데 관심

[10] 속속 드러나는 오픈AI 자금 확보…65억달러 유치·50억달러 대출

[11] Capital spending soars in the cloud as Microsoft, Google, and others bet big on AI demand

[12] As Big Tech Ramps Up AI Spending, Investors Worry Whether AI Costs Will Pay Off

[13] “챗GPT는 레벨1”…오픈AI, AGI 기술 달성 계획 5단계로 나눠

[14] OpenAI Defines Five Steps From AI to AGI

[15] Can AI Scaling Continue Through 2030?

[16] The AI Scientist: Towards Fully Automated Open-Ended Scientific Discovery

[17] II. From AGI to Superintelligence: the Intelligence Explosion

[18] Ilya Sutskever on how AI will change and his new startup Safe Superintelligence